“Los peligrosos algoritmos de Meta, propietaria de Facebook, y su temerario afán de lucro contribuyeron sustancialmente a las atrocidades perpetradas por el ejército de Myanmar contra la población rohinyá en 2017”, afirma Amnistía Internacional en un nuevo informe que se publica en el quinto aniversario de la represión de la población rohinyá.

La atrocidad social Meta y el derecho a un recurso para la comunidad rohinyá detalla que Meta sabía o debía haber sabido que los sistemas de algoritmos de Facebook estaban impulsando la difusión de contenido dañino antirrohinyá en Myanmar, pese a lo cual la empresa no hizo nada.

“En 2017, miles de personas rohinyás fueron víctimas de homicidio, tortura, violación y desplazamiento como parte de la campaña de limpieza étnica de las fuerzas de seguridad de Myanmar.

En los meses y años que desembocaron en las atrocidades, los algoritmos de Facebook intensificaron una tormenta de odio contra la población rohinyá que contribuyó a la violencia en el mundo real”, dijo Agnès Callamard, secretaria general de Amnistía Internacional.

“Mientras el ejército de Myanmar cometía crímenes de lesa humanidad contra la población rohinyá, Meta se beneficiaba de la cámara de resonancia del odio creado por sus algoritmos intensificadores de odio.

Meta debe rendir cuentas La empresa tiene ahora la responsabilidad de proporcionar una reparación a todas las personas que sufrieron las consecuencias violentas de sus temerarias acciones”.

Sawyeddollah, refugiado rohinyá de 21 años, dijo a Amnistía Internacional: “Vi un montón de cosas horribles en Facebook. Y sólo pensé que la gente que publicaba eso era mala [...] Luego me di cuenta de que no son sólo estas personas —las que publicaban—, sino que Facebook es también responsable. Facebook las está ayudando al no controlar su plataforma”.

La población rohinyá es una minoría étnica predominantemente musulmana que vive en el norte del estado de Rajine. En agosto de 2017, más de 700.000 rohinyás huyeron de Rajine cuando las fuerzas de seguridad de Myanmar lanzaron una campaña selectiva y generalizada de asesinatos, violaciones e incendios sistemáticos de casas. La violencia estalló después de décadas de discriminación, persecución y opresión promovidas por el Estado contra la población rohinyá que constituye apartheid.

Una cámara de resonancia antirrohinyá

Meta usa sistemas de algoritmos basados en la participación para impulsar los servicios de novedades, clasificación, recomendación y grupos de Facebook que configuran lo que se ve en la plataforma. Meta se beneficia cuando quienes usan Facebook permanecen el mayor tiempo posible en la plataforma vendiéndoles más publicidad selectiva. La exhibición de contenidos incendiarios —incluidos los que propugnan el odio y los que constituyen incitación a la violencia, la hostilidad y la discriminación— es una forma efectiva de mantener a la gente más tiempo en la plataforma. De este modo, la promoción y amplificación de este tipo de contenido es clave para el modelo empresarial de Facebook basado en la vigilancia.

En los meses y años que desembocaron en las atrocidades de 2017, Facebook en Myanmar se había convertido en una cámara de resonancia de contenido antirrohinyá. Actores ligados al ejército de Myanmar y grupos nacionalistas budistas radicales inundaron la plataforma de contenido antimusulmán, publicando desinformación sobre una inminente toma del poder musulmana en el país y representando a la población rohinyá como “invasores”.

En un post que se compartió más de 1.000 veces, un defensor musulmán de los derechos humanos fue representado y calificado de “traidor nacional”. Los comentarios al post incluían mensajes de amenaza y racistas, como: “Es musulmán. Los musulmanes son perros y hay que matarlos a tiros” y “No lo dejen con vida. Eliminen a toda su raza. El tiempo apremia”.

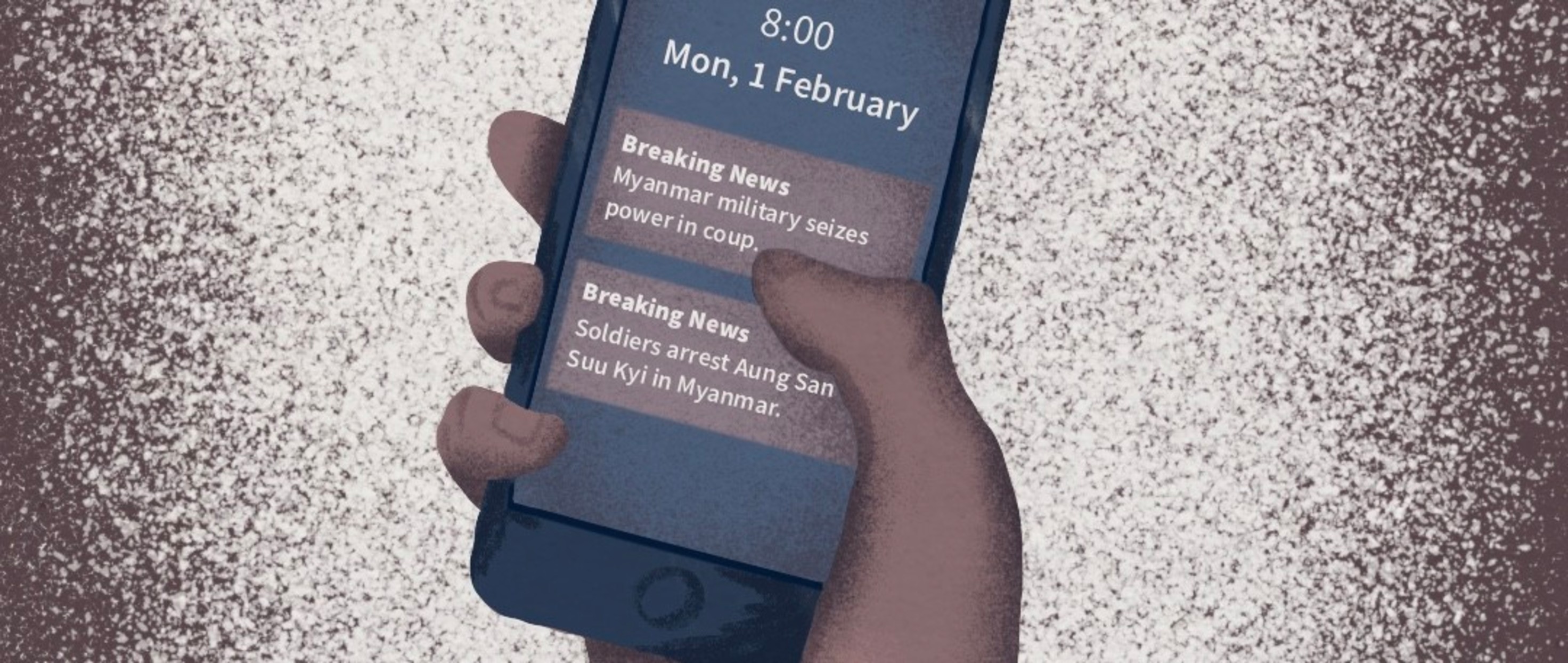

El contenido que incitaba a la violencia y a la discriminación llegó hasta la misma cúpula de los dirigentes militares y civiles de Myanmar. El general Min Aung Hlaing, jefe de las fuerzas armadas de Myanmar, publicó en su página de Facebook en 2017: “Declaramos abiertamente que, rotundamente, nuestro país no tiene ninguna raza rohinyá”. El general tomó el poder en un golpe de Estado en febrero de 2021.

En 2014, Meta trató de respaldar una iniciativa contra el odio conocida como “panzagar” o “lenguaje flor” con la creación de un paquete de stickers para que publicaran los usuarios y usuarias de Facebook en respuesta a contenidos que propugnaban la violencia o la discriminación. Los stickers llevaban mensajes como “piensa antes de compartir” y “no seas la causa de la violencia”.

Sin embargo, activistas observaron enseguida que los stickers tenían consecuencias imprevistas, pues los algoritmos de Facebook interpretaban su uso como señal de que a la gente le gustaba un post y empezó a promoverlos. En lugar disminuir el número de personas que veían una publicación que propugnaba el odio, los stickers hacían que ésta fuera más visible.

La Misión Internacional Independiente de Investigación de las Naciones Unidas sobre Myanmar concluyó en última instancia que el “papel de los medios sociales [fue] considerable” en las atrocidades en un país en el que “Facebook es Internet”.

Mohamed Showife, activista rohinyá, dijo: “El pueblo rohinyá sólo sueña con vivir igual que otras personas en este mundo [...] pero ustedes, Facebook, ustedes destruyeron nuestro sueño”.

La inacción de Facebook

El informe detalla que, en reiteradas ocasiones, Meta no aplicó la debida diligencia en materia de derechos humanos en sus operaciones en Myanmar, a pesar de su responsabilidad de al respecto prevista en las normas internacionales.

Hay estudios internos que se remontan a 2012 que indicaban que Meta sabía que sus algoritmos podían provocar daños graves en el mundo real. En 2016, las propias investigaciones de Meta reconocían claramente que “nuestros sistemas de recomendación aumentan el problema” del extremismo.

Meta recibió reiteradas comunicaciones y visitas de activistas de la sociedad civil local entre 2012 y 2017 en las que la empresa fue advertida de que podía contribuir a violencia extrema. En 2014, las autoridades de Myanmar llegaron a bloquear temporalmente Facebook por el papel de la plataforma en desencadenar un estallido de violencia étnica en Mandalay. Sin embargo, de forma reiterada, Meta no escuchó los avisos ni hizo cumplir sus propias políticas sobre lenguaje que incita al odio.

La investigación de Amnistía Internacional incluye análisis de nuevos datos procedentes de los “Papeles de Facebook”, una serie de documentos internos filtrados por la denunciante de irregularidades Frances Haugen.

En uno de ellos, fechado en agosto de 2019, una persona que trabajaba en Meta escribió: “Tenemos datos de diversas fuentes de que el lenguaje que incita al odio, el lenguaje político divisivo y la desinformación en Facebook afectan a sociedades de todo el mundo. También tenemos datos fehacientes de que las mecánicas de nuestro producto central, como la viralidad, las recomendaciones y la optimización para la participación, son una parte significativa de la razón por la que estos tipos de lenguaje florecen en la plataforma”.

La falta de personal fue otro problema fundamental, pues, según informes, Facebook tenía sólo a cinco personas de lengua birmana para vigilar y moderar el contenido para los 18 millones de personas que usaban Facebook en Myanmar en 2018.

“Meta debe pagar”

Amnistía Internacional lanza hoy una nueva campaña en la que pide a Meta Platforms, Inc. que atienda la reclamación de reparación de la comunidad rohinyá.

Grupos de personas refugiadas rohinyás han pedido directamente a Meta una reparación mediante la financiación con un millón de dólares estadounidenses de un proyecto de educación en el campo para personas refugiadas de Cox’s Bazar, en Bangladesh. Esta cantidad representa sólo el 0,002% de los beneficios de Meta en 2021 de 46.700 millones de dólares. En febrero de 2021, Meta rechazó la petición de la comunidad rohinyá afirmando: “Facebook no participa directamente en actividades filantrópicas”.

Showkutara, una joven activista rohinyá de 22 años, dijo a Amnistía Internacional: “Facebook debe pagar. De lo contrario, acudiremos a todos los tribunales de justicia del mundo. Nunca renunciaremos a nuestra lucha”.

Existen al menos tres demandas judiciales activas en las que se reclama a Meta una reparación para la población rohinyá. En diciembre de 2021 se presentaron sendas demandas civiles contra la empresa en Reino Unido y Estados Unidos. Además, grupos de personas refugiadas jóvenes rohinyás han interpuesto contra Meta una demanda ante la OCDE que está actualmente en estudio del Punto Nacional de Contacto de la OCDE en Estados Unidos.

“En virtud de las normas internacionales de derechos humanos, Meta tiene la responsabilidad de reparar el terrible daño sufrido por la población rohinyá al que ha contribuido. Las conclusiones deben servir de aviso de que Meta podría contribuir a más abusos graves contra los derechos humanos si no hace cambios fundamentales en su modelo empresarial y sus algoritmos”, concluyó Agnès Callamard.

“Son imprescindibles unas reformas urgentes de amplio alcance en sus sistemas de algoritmos para prevenir abusos y aumentar la transparencia a fin de garantizar que la historia de Meta con la población rohinyá no se repite en otro lugar del mundo, especialmente donde existe una violencia étnica latente”.

“En última instancia, los Estados deben contribuir ahora a la protección de los derechos humanos mediante la introducción y aplicación de leyes efectivas que frenen los modelos empresariales del sector tecnológico basados en la vigilancia. Las grandes empresas tecnológicas han demostrado que son incapaces de hacerlo cuando se juegan unas ganancias tan descomunales”.

El 20 de mayo de 2022, Amnistía Internacional escribió a Meta en relación con las medidas de la empresa relativas a sus actividades empresariales en Myanmar antes y durante las atrocidades de 2017. Meta respondió que no podía facilitar información sobre el periodo anterior a 2017 porque la empresa está “actualmente involucrada en un procedimiento judicial en relación con asuntos afines”.

El 14 de junio de 2022, Amnistía Internacional volvió a escribir a Meta en relación con las acusaciones contenidas en el informe y dio a la empresa la oportunidad de responder. Meta se negó a hacer comentarios.